zurück

NVIDIA Tesla H100 Tensor 96GB Server VDI KI GPU SXM5 PCIe x16 350W

Artikelnummer: A39651

Basispreis: 26.221,00 €

inkl.

19% MwSt | exkl. Versandkosten

Preis exkl. MwSt.: 22.034,45 €

z.B. Leasingdauer 36 Monate: € inkl. / € exkl.

zum Leasingrechner

Verfügbarkeit:

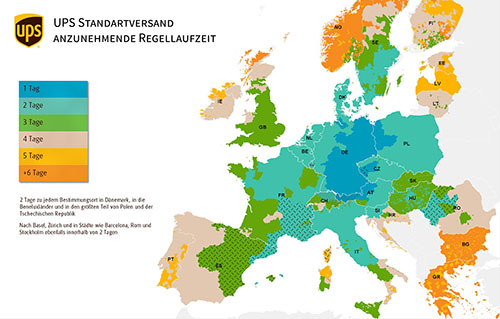

Lieferzeit: 1-2 Tage + Paketlaufzeit

Gewicht: 1.95kg

Hersteller / OEM: NVIDIA /

Modell: Tesla Ampere

PN: A100 #

Controller Typ: Grafik

Host Bus: PCIe x16

Schnittstellen: x

TDP (Watt): 350

NVIDIA Tesla H100 96 GB – Extreme Performance für AI & HPC

Die NVIDIA Tesla H100 96 GB ist das Flaggschiff für moderne KI-Workloads, Large Language Models, HPC und Data Analytics.

Basierend auf der Hopper-Architektur liefert sie einen massiven Leistungssprung gegenüber der A100 und setzt neue Maßstäbe in Training, Inference und wissenschaftlichem Rechnen.

Dank 96 GB HBM3-Speicher, extrem hoher Speicherbandbreite und 4th-Gen Tensor Cores ermöglicht die H100 das effiziente Training

und den Betrieb selbst größter Modelle mit maximaler Energieeffizienz und Skalierbarkeit für Rechenzentren.

Technische Highlights

konzipiert für:

High-Performance-Computing

Deep-Learning-Training und -Inferenz maschinelles Lernen

Datenanalysen und Grafik

GPU-Architektur: NVIDIA Hopper (H100)

Speicher: 96 GB HBM3

Speicherbandbreite: bis zu 3,35 TB/s

Tensor Cores: 4. Generation (FP8, FP16, BF16, TF32, INT8)

FP8 AI Performance: bis zu ~4.000 TFLOPS

FP16 / BF16: bis zu ~1.979 TFLOPS

FP64: bis zu ~60 TFLOPS

Leistungsaufnahem: 350W

Interconnect: NVLink (bis 900 GB/s GPU-zu-GPU)

PCIe: PCIe 5.0

Virtualisierung: MIG (Multi-Instance GPU)

Zielanwendungen: AI Training & Inference, LLMs, HPC, Simulation, Data Science

Vorteile auf einen Blick

Enorme KI-Performance pro Watt

Optimal für LLMs & Generative AI

Maximale Speichergröße & Bandbreite

Skalierbar für Multi-GPU-Cluster

Zukunftssicher durch PCIe 5.0 & NVLink

Die NVIDIA Tesla H100 96 GB ist das Flaggschiff für moderne KI-Workloads, Large Language Models, HPC und Data Analytics.

Basierend auf der Hopper-Architektur liefert sie einen massiven Leistungssprung gegenüber der A100 und setzt neue Maßstäbe in Training, Inference und wissenschaftlichem Rechnen.

Dank 96 GB HBM3-Speicher, extrem hoher Speicherbandbreite und 4th-Gen Tensor Cores ermöglicht die H100 das effiziente Training

und den Betrieb selbst größter Modelle mit maximaler Energieeffizienz und Skalierbarkeit für Rechenzentren.

Technische Highlights

konzipiert für:

High-Performance-Computing

Deep-Learning-Training und -Inferenz maschinelles Lernen

Datenanalysen und Grafik

GPU-Architektur: NVIDIA Hopper (H100)

Speicher: 96 GB HBM3

Speicherbandbreite: bis zu 3,35 TB/s

Tensor Cores: 4. Generation (FP8, FP16, BF16, TF32, INT8)

FP8 AI Performance: bis zu ~4.000 TFLOPS

FP16 / BF16: bis zu ~1.979 TFLOPS

FP64: bis zu ~60 TFLOPS

Leistungsaufnahem: 350W

Interconnect: NVLink (bis 900 GB/s GPU-zu-GPU)

PCIe: PCIe 5.0

Virtualisierung: MIG (Multi-Instance GPU)

Zielanwendungen: AI Training & Inference, LLMs, HPC, Simulation, Data Science

Vorteile auf einen Blick

Enorme KI-Performance pro Watt

Optimal für LLMs & Generative AI

Maximale Speichergröße & Bandbreite

Skalierbar für Multi-GPU-Cluster

Zukunftssicher durch PCIe 5.0 & NVLink

Artikelzustand: refurbished / generalüberholt, Grade A. Artikel wurde vom Verkäufer vollständig geprüft / instandgesetzt.

Herstellerinformationen:

info@nvidia.com

NVIDIA GmbH

2788 San Tomas Express Way

Santa Clara, CA 95051

USA

info@nvidia.com

NVIDIA GmbH

Adenauer Str. 20/A4

52146 Würselen

Deutschland